创建强化学习训练任务

强化学习(Reinforcement Learning, RL),又称再励学习、评价学习或增强学习,是机器学习的范式和方法论之一,用于描述和解决智能代理(agent)在与环境的交互过程中通过学习策略以达成回报最大化或实现特定目标的问题。

强化学习主要是训练对象每一步如何进行决策,采用什么样的行动可以完成特定的目的或者使收益最大化。

登录到千帆大模型操作台,在左侧功能列RLHF训练中选择强化学习训练,进入强化学习训练主任务界面。

创建任务

您需要在强化学习训练任务界面,选择“创建训练任务”按钮。

填写好任务名称后,在范围内选择所属行业和应用场景,再进行500字内的业务描述即可。

创建并训练创建并训练直接开启训练模型的运行配置界面;“完成创建”仅创建任务不创建训练模型的运行。

新建运行

您可以在创建任务时选择“创建并训练”,或者在强化学习训练任务列表中,选择指定任务的“新建运行”按钮。

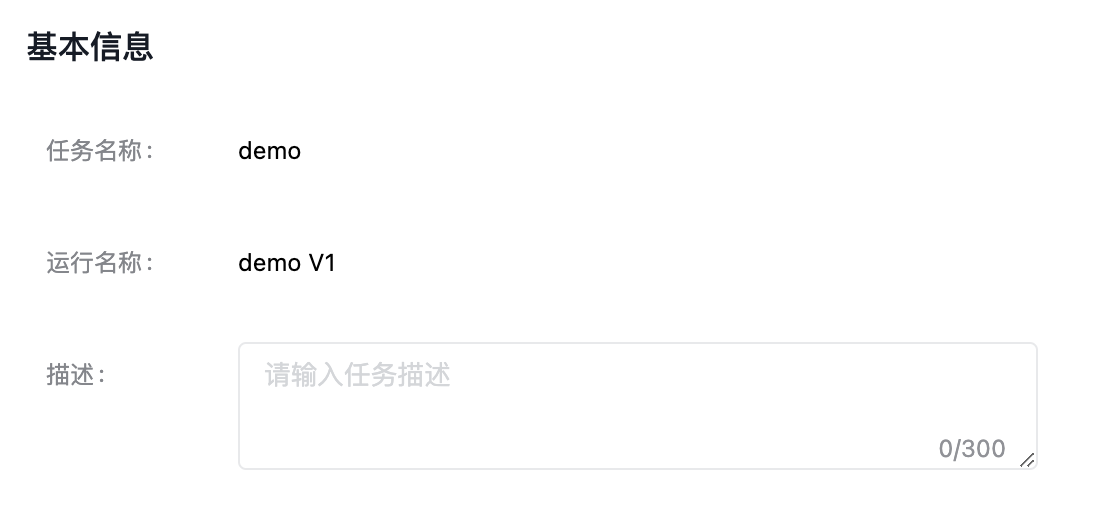

进入强化学习的任务运行配置页,填写基本信息。

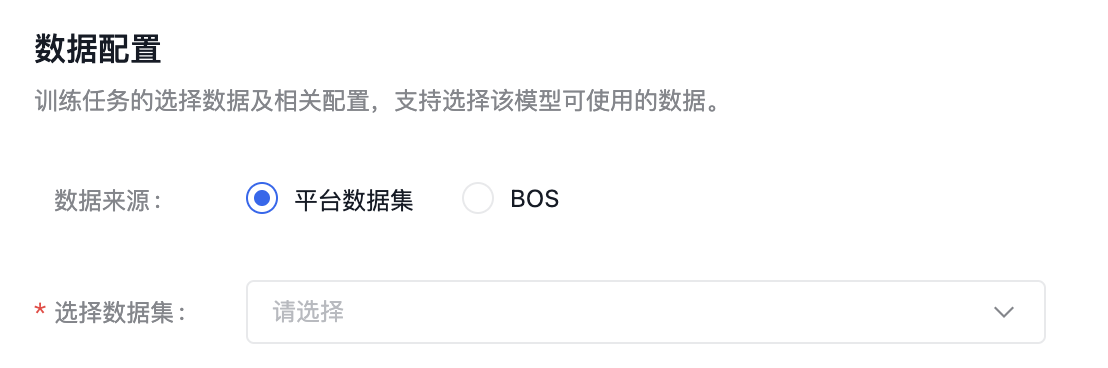

数据配置

选择训练任务的数据及相关配置,强化学习训练任务匹配query问题集。

建议数据集总条数在1000条以上,训练模型更加精准。

数据集来源可以为千帆平台已发布的数据集版本,也可以为已有数据集的BOS地址,详细内容可查看数据集部分内容。

若数据集保存在BOS中,请勿在提交任务后修改BOS数据。修改后可能会导致任务失败!

需注意:当选择BOS目录导入数据集时,数据放在jsonl文件夹下。您需要选择jsonl的父目录:

- 奖励模型支持单轮对话、多轮对话有排序数据。

- RLHF训练支持仅prompt数据。

- SFT支持单轮对话,多轮对话需要有标注数据。

- BOS目录导入数据要严格遵守其格式要求,如不符合此格式要求,训练作业无法成功开启。详情参考BOS导入数据信息格式。

百度BOS服务开通申请。

训练配置

- 选择大模型

- 预置大模型:BLOOMZ-7B

知名的大语言模型,由BigScience研发并开源,能够以46种语言和13种编程语言输出文本。 - 用户大模型:用户自建基于BLOOMZ-7B训练的调优大模型

由SFT所建,强化学习更匹配私有业务场景。

- 预置大模型:BLOOMZ-7B

- 选择奖励模型:平台运行成功的奖励模型版本

在平台奖励模型的基础上,继续完成强化训练,训练出最大化靠近人类反馈的模型。 - 参数配置

| 超参数 | 简单描述 |

|---|---|

| 迭代轮次 | 迭代轮次(epoch),控制训练过程中的迭代轮数。 |

| 批处理大小 | 批处理大小(Batchsize)表示在每次训练迭代中使用的样本数。较大的批处理大小可以加速训练,但可能会导致内存问题。 |

| 学习率 | 学习率(learning_rate)是在梯度下降的过程中更新权重时的超参数,过高会导致模型难以收敛,过低则会导致模型收敛速度过慢,平台已给出默认推荐值,可根据经验调整。 |

以上所有操作完成后,点击“确定”,则发起模型训练的任务。

最后修改时间: 1 年前