快速导入并部署第三方模型

前提准备

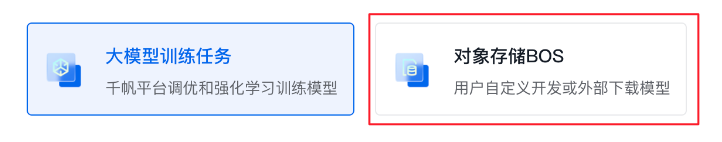

1.

2.

3.

导入模型

1.

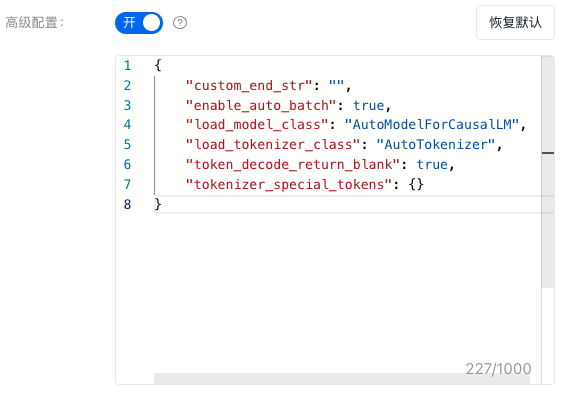

{

"load_model_class": "AutoModelForCausalLM",

"load_tokenizer_class": "AutoTokenizer",

"enable_auto_batch": true,

"custom_end_str": "",

"token_decode_return_blank": true,

"tokenizer_special_tokens": {}

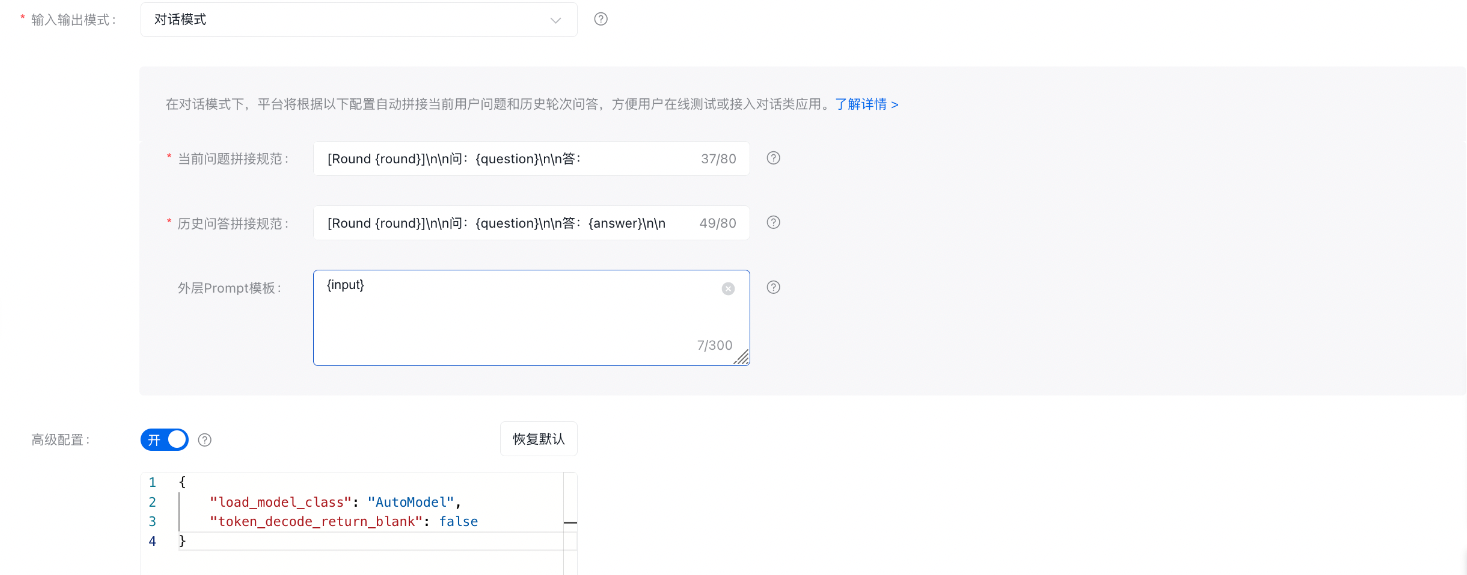

}多轮对话chat模型导入示例-chatglm2-6b-int4

{

"load_model_class": "AutoModel",

"token_decode_return_blank": false

}

单轮问答模型导入示例-sqlcoder

其中高级配置使用默认配置。

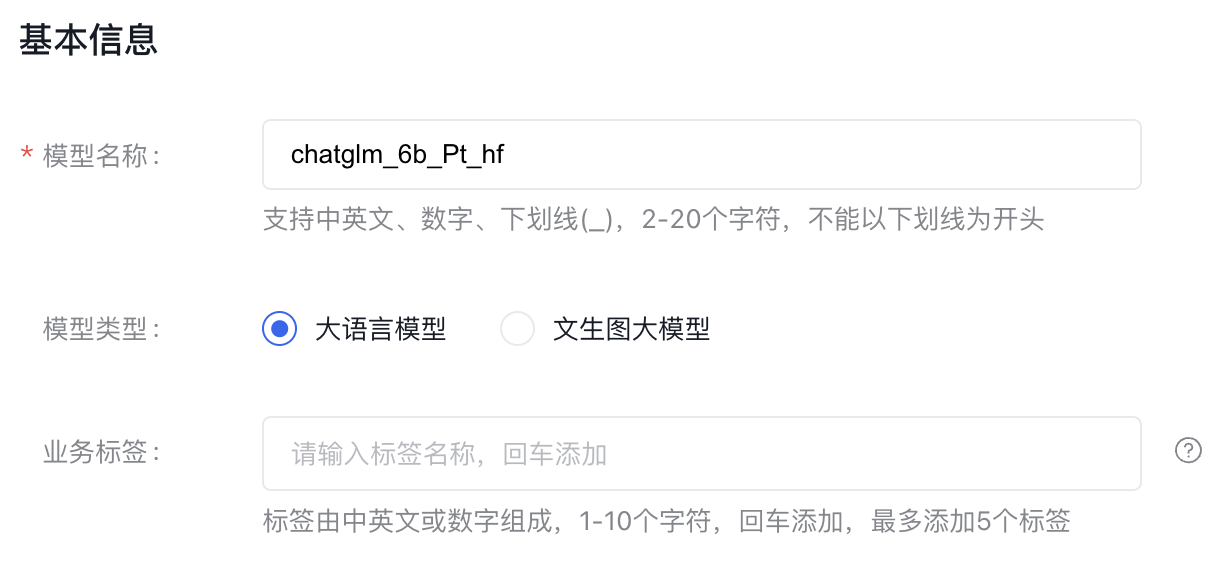

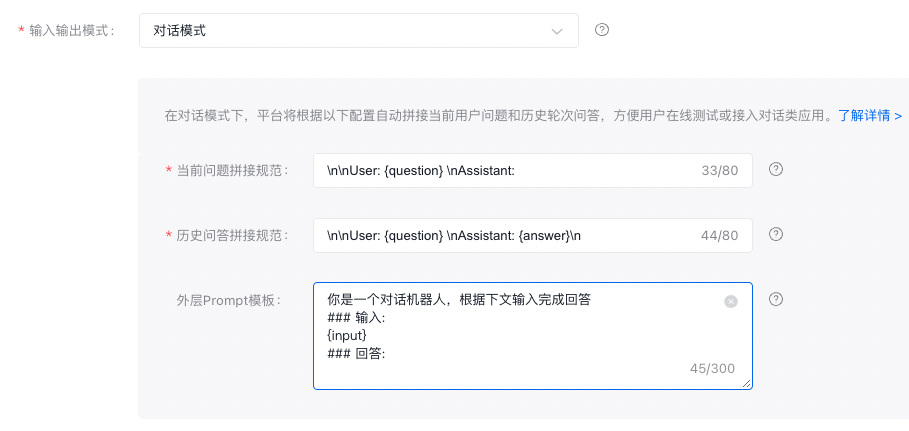

本地全量参数微调后的chatglm2-6b模型导入示例

1.

1.

1.

1.

{

"custom_end_str": "",

"enable_auto_batch": true,

"load_model_class": "AutoModelForCausalLM",

"load_tokenizer_class": "AutoTokenizer",

"token_decode_return_blank": true,

"tokenizer_special_tokens": {}

}

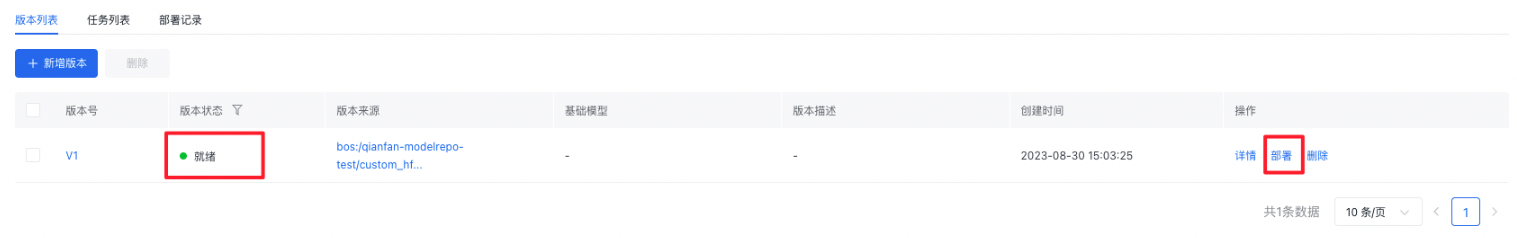

部署服务

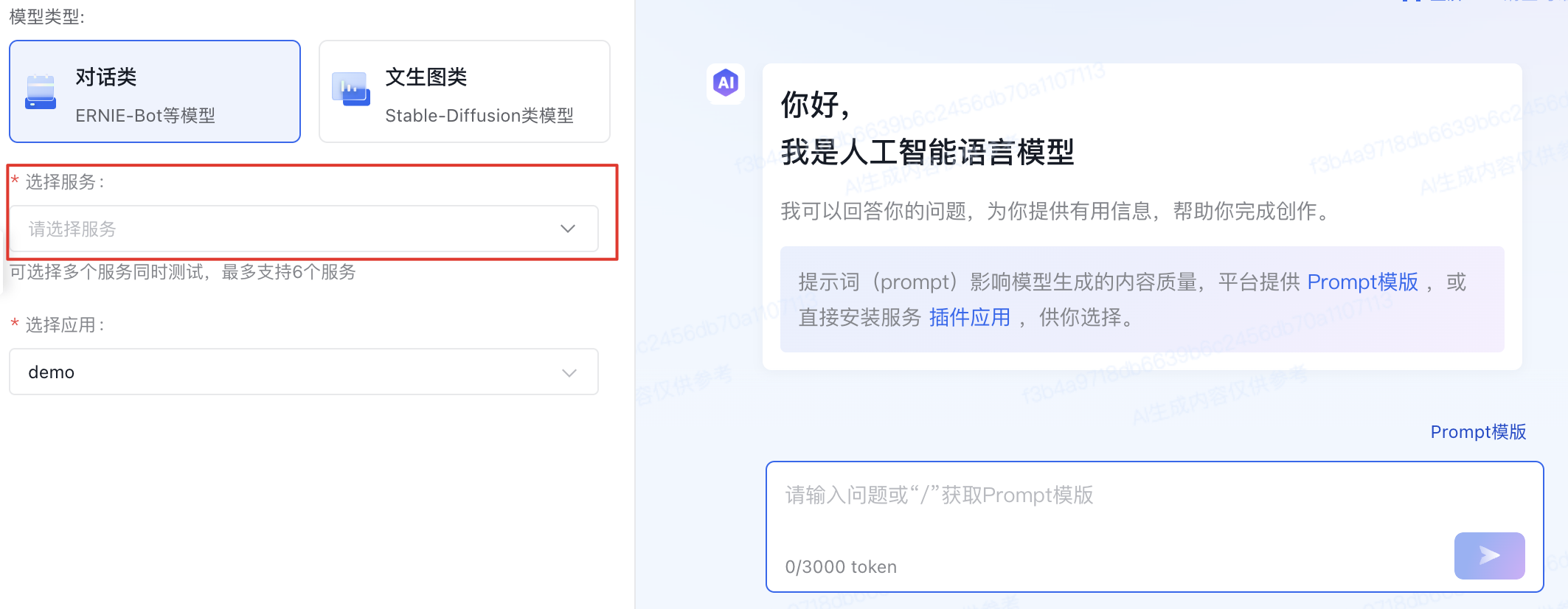

在线测试

修改于 2023-11-15 02:14:04